当人们谈论‘概率’时,他们到底在指什么 ?

我可能在初中时便学到‘概率’这个数学词汇,也一直以来觉得与此相关的数学问题都很简单。

但直到自己接触了统计学习 / 机器学习的一些理论时,才意识到自己从来没有仔细思考过,‘概率’到底指的是什么。

在读了一些关于概率学历史的资料后,我决定写这篇文章,作为自己的总结,也与人们分享。

不确定性的起源

就先从生活场景切入思考概率吧。我们常在说话时使用这样的副词:可能,也许和大概,用以表达对自己所陈述内容的‘不确定’。但这个不确定性究竟来自于哪里呢 ?

于是我们会开始想些具体的例子:

最近气温可能要上升了

那台机器这会儿大概还在运行

抛一枚密度完全均衡的硬币后,正面朝上的概率是0.5

那我们来对这几个例子分开讨论。

事物本身和认知局限

当我们说气温可能要上升了,我们实际上是在对一件未来的事进行描述。但基于我们的知识和历史经验,我们知道气温的影响因素实在太多了,而目前的科技仍难以观察和跟踪整个环境的所有细节。因此在描述这件未来发生的事时,我们只能通过对这个环境系统的一部分的观察,来进行猜测。

也就是说,我们对未来气温变化的不确定,既来自环境系统自身的复杂 (可能也存在随机性,我不知道),也来自我们对系统了解的局限。

认知局限

当我们描述一台熟悉的机器当下的状况时,我们同样利用了经验 – 比如机器每天这个时候都在运行,或者我们刚刚才启动了机器。而我们却说它这会儿‘大概’仍在运行,不过是因为我们对机器此时此刻的状态并不了解 (比如不在机器身边)。

但机器此刻的状态是固定的,不随我们的认知所改变的。换句话说,只要让人去机器边看一眼,我们的描述就可以变成‘机器正在运行’,或者‘机器不在运行’。也就是说,这里的不确定性只来自人认知的不足。

事物本身

写到这儿,大概读者也不难猜出,抛硬币这件事的不确定性,与前两个例子相反,恰巧来自于我们对假象硬币这个物体的充分了解。我们知道,硬币自身的物理属性决定了它被抛出落下后的朝向是完全随机的。

例子的缺陷

有人可能会说,如果我们能够对抛硬币瞬间所有的微观细节进行观察,便能准确地推测出它落下后的朝向,那么硬币和周围环境组成的系统的状态完全可预测的,是确定的而非随机的。

也有人可能会说,人无法观察到一个系统的所有细节,第二个例子里的机器是否‘正在运行’,也不是看一眼就能确定的,机器这个系统自身的不确定性仍然存在。

是的,做出完美的无法从任何细节反对的描述是件挺困难的事。我用这两个例子只是想说明,人在描述不同事物的不确定性时,不确定性的来源是不同的,可以是人的自身,可以是事物本身,也可以同时来自二者,也可以来自于其他的地方。

这篇文章描述的是截止至当下(2019年)人们对概率和世界的理解。随着科学的发展,人类若能掌握整个世界的所有微观细节,而且能实时推测出下一时间点事物的状态,完全消除不确定性。那么概率论这们学科也就不复存在了吧。

当下的概率论

就像对上面几个例子的讨论,与概率相关的理论,最早也是从对不确定性的讨论开始的。随着时间的推进和人类对世界的更多了解,更多的概率理论也相继被提出。

能延续至今的理论目前仍然自洽,不同理论并不相驳甚至相辅,它们代表着不同的学者群体对世界的不同理解,和解释世界所建立的模型,因此当下仍然存在着不同的概率论学派。

古典概型

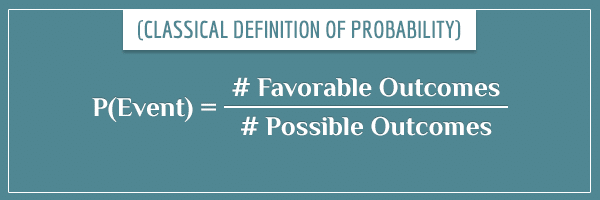

按照习惯,我们把最早出现的与概率相关的理论称作古典概型 (Classical Definition of Probability)

请暂时忘掉我们平时用的 ‘明天有80%的概率下雨’ 之类的思维方式,这个理论中的 ‘概率’ 不过是被按照如下规则计算出的一个数字。

它也只能在很狭窄的情景里被计算,来描述一个事件 (Event)。事件的定义是:任意个可能结果组成的集合。

在古典概型理论中,概率就是这么个数字:

先定义事件的所有结果 (它们的集合被称作概率空间),同时确保定义时,不同结果间互斥且每个结果有同等几率发生。

(比如抛骰子后朝上的数字有6种结果,它们发生几率相等,而且不可能同时出现两个数字,即互斥)

确定所感兴趣的事件,再挑出能代表这一事件的所有结果 (Favorable Outcomes)

(比如我们想了解 ‘骰子朝上的数字是偶数’ 这一事件,那么能代表它的结果有 2, 4 和 6)

计算步骤2中的结果在步骤1中定义的所有结果中的比例 - 除法运算。

局限

按照这套概率论,为了计算概率这一数字,必须得先定义了概率空间,也就是一个所有结果组成的集合。

刚读完这个定义,大概会觉得这真麻烦啊,为了计算一个事件的‘概率’,还得先把所有的结果列出来。

如果有无数种结果怎么办 ? 如果我们并不知道可能有哪些结果怎么办 ?

是的,这就是古典概型理论的缺陷。或者说,它定义的概率只是特定情形下可计算的一个数值,跟我们今天所说的概率并不完全是同一件事吧。

无差异原则

这里先假设我们成功地找到并列出了一件事的所有结果,回到定义,我们又发现,它还要求每个结果都必须 ‘有同等几率发生’ (Equally likely),这很容易带来困惑 - 几率是啥,不同于概率么

这意味着我们不得不先回答这两个问题中的至少一个:

- ‘几率’到底指什么呢 ?

- 我们怎么知道自己定义的不同结果有 ‘有同等几率发生’呢 ?

历史上也有产生同样困惑的人,他们因此发明了另一个概念来解决第二个问题 - 无差异原则 (Principle of Indifference)

原则如下:如果导致两个结果发生的因素是对称的,那么他们有同等几率发生。

那问题又来了:

- 什么是因素 ?

- 什么样的因素是对称的呢 ?

对称即可互换

回到骰子的例子,骰子本身是一个正方体形状的物体,它的六个面被标记了不同的数字。常见的标记是1到6这几个数字。但我们完全可以用其他数字,甚至字母A到F来标记不同的面。

我们已经把 ‘抛完骰子后朝上的面被标记的数字’ 定义为结果,那么导致我们得到每个结果的因素都有两个:

骰子被抛出后经历的运动过程

最后朝上的面被标记的那个数字

在比较不同的结果时,比如数字1和2,如果我们把一个骰子上标有这两个数字的两个面 重新标记为2和1 (互换),得到的新骰子在进行抛掷实验时,将呈现和之前完全一样的结果。

那么我们说,导致每个结果的第二个因素 (每个面的标记)是对称而可互换的,而导致它们的第一个因素(骰子的随机运动)是相同的。那么就可以说,被这样(用每个面的数字)定义的结果们都 ‘有同等几率发生’。

这就是无差异原则的用途 - 用来定义和判断 ‘等几率发生’。

反证法

无差异原则的另一个用法是,如果有人提出,结果A比结果B‘有更大几率发生’时,我们可以从这个假设推出矛盾之处 - 分析导致不同结果的因素,再将这其中不同的因素(比如骰子的数字标记)互换,进而得出 ’结果B比结果A有更大几率发生‘ 的矛盾结论。

概率即频率

古典概型论将‘概率’一词局限在一个很狭窄的情景下,那么自然有人不满足于此,而重新定义概率啦。

这个理论中,概率被用来描述‘可被重复的事’的多次发生后的结果。准确说:当一件事被重复进行无数次后,某个结果出现的频率就是这个结果的概率。

频率的优势

在这个理论中研究概率,与古典概型不同,并不需要在事情发生前就分析各种可能结果,也就更不需要用到无差异原则。只要分析和估计一件事被执行很多次之后某一结果发生过的频率即可。

必须长期重复

但要注意的是,这个理论认为概率只能描述 ‘无限次做一件可被重复的事’ 之后某个结果的发生频率。也就是说,“假如现在我们随手抛一枚硬币,将得到正面” 的概率并不存在,单次实验并没有概率可言。

不足之处

那么读完定义,我们自然好奇,万一一件事不能被重复怎么办呢 ?比如明天会下雨。毕竟每一天的天气和环境在时间轴上是独一无二的。

或者不能被大量重复怎么办 ?比如锂电池只能充电有上限次数,我们无法研究它‘充完电达到95%容量’的概率,而电池的物理属性也在不断变化,影响其容量。

是的,这个理论所说的概率,并不是用来描述这类事情的可能性的。

这个概率到底指啥

准确说,这里把概率定义成一个常量,像光速,地表重力加速度一样。它描述的是一件事物所具有的固定属性 - 即被无限次重复后,各个结果的频率将将逼近的那个固定数值。

这也就意味着,这个理论的概率无法被直接测量,因为谁也无法重复一个过程无数次。但是呢,它仍然指明了当在一件事被大量重复后,任意结果的频率都将无限趋近于这个结果的概率。

可以打折个比方,圆周率具体是多少呢,我们不得而知,但精确到小数点后几万位的估计值我们是知道的。相似的是,用这个理论时,结果A的概率我们不知道,但我们可以重复一件事很多次,然后计算出结果A的频率,根据大数定理,这个频率将是一个靠谱的对结果A的概率的估计值。

总的来说,它几乎只能被来分析可重复的事:投骰子的结果,抛硬币的结果,随机抽牌的结果,等等。

物理倾向性

频率学说总有一种浓厚的数学气息,它总在讨论一种完美的情形,比如事请可以被无限重复,而且把概率定义在了这种情形背后的一个神秘常量。

就好像数学家喜欢直接讨论N维空间的种种数值计算,而物理学家通常只在乎3维内的具体情况。

于是自然有人,也就是现在要介绍的这个学派,把概率定义为物理倾向性(Propensity)

他们觉得,我们用概率来表示一件事物,在指定情形下,驱动结果的物理性质就好。

开放性

在这个框架下,我们不再像频率学派那样讨论完美的事物,无限重复的实验。我们可以随手捡起一个真实的密度不完全均匀的骰子,再测量它的质量分布,而估计说 “现在投掷这个骰子一次后,X面朝上的概率是0.17”

我们可能无法把概率精确到小数点后多少位,但是在这个定义下,概率表示一个现实物体的物理性质,或者说导致各种结果的倾向性。不同的骰子完全可以有极度细微不同的倾向性数值。

比起频率学说,现在我们可以用概率来描述单次发生事件的某个结果啦。

大数定理

可以说,物理倾向性是频率学说的现实化版本,像物理之于数学。可能倾向性学派觉得,把概率定义成现实中就可以测量估计的数值,比较实在。也可以说,倾向性说法弥补频率学说的现实意义。

那它们是怎么相互联系的呢 - 用的就是大数定理。

当你在相同而独立的条件下 (I.I.D.) 重复一件事情,随着次数增加,每次重新计算某一结果的频率,这个数值将会不断接近它的真实概率。

这个每次计算的频率也就代表着我们对概率的最新 / 更接近真实的估计值。

这个定理所描述的现象跟地球引力有点像:我们在楼顶抛出一架纸飞机后,飞机可能会走各种路径,但最终都会落在某地,因为地球引力。而当我们按要求重复一件事很多次,即便每次得到的结果不同,但如果我们去留意每个结果的频率,它们总是越来越接近着某个数值(概率)。

还有一个问题,多大的数算大数呢 ?其实更好的问题应该是,我们究竟想要对概率做多么准确的估计。当我们希望对概率的估计越准确时,按照大数定理,我们需要进行的试验次数也就越多。

那么除了次数外,还有什么会影响我们对概率的估计呢,或者说会影响频率接近概率的速率呢 ?

- 事件结果的多样性。

一个例子是投骰子(任意)结果的频率接近 1/6 所需要的实验次数远多于投硬币结果接近 1/2 所有需要的试验次数。

结合无差别定理

把概率看作物理倾向性的另一个优点是,可以把物理属性和无差别定理结合来增加说服力。

比如我们可以说,一个骰子的质量是完全均匀分布的,那么它也就不倾向于以任何一个面落地,因此任何面朝上的概率是相等的。(尽管现实中的这样的骰子并不存在)

客观与主观

到此我们讨论了古典概型,频率学说和物理倾向性学说。概率一词在演化过程中,变得越来越通用而实际。而这些学说的特点是,都完全基于客观事实,它们的概率与人无关,与人所掌握的知识或者单纯的信念程度无关。

这与我们当下日常口头所使用的概率(大概会,更可能)还是有点不同的,因为我们在表达可能性或者概率时,或多或少都习惯地基于自己的经验知识来描述,是会引入主观信念的。

相信程度

那么在历史上,当然也有这样想人啦,他们所组成的学派把概率定义为 “人对某个事件发生与否的相信程度”。贝叶斯学派所提出的一系列理论也是基于这样的思想。

任何事

在把概率定义为"相信程度"后,我们发现几乎任何事都可以有概率。我们可以用于已发生的事实,德国在二十世纪初,有20%概率不打算发动二战。可以讨论未来,明天有80%的概率会下雨。也可以讨论完全空想的事,宇宙中存在其他文明的概率是99%。

但要注意,这里利用概率所做的陈述是完全主观的,未必与真理相关。比如一个出生在21世界的人,可以直接说 “我认为二战完全没有发生(或有100%的概率是人们编造的故事)"。

当然啦,提出"概率即相信程度"的学者的目的是,拓展概率的允许使用范围,让它能灵活地表达更多的事,而不局限于那些 “可重复” “试验无数次才能知晓” 的事。

更新概率

当我们把概率定义为“相信程度”之后,概率也就不再是一个固定的数值了,每个人对同一件事的相信程度不同,而对同一个人而言,随着经验和知识的增长,他对事物的相信程度也在改变。

相信程度在科学研究里并不是随意改变的,一个比较有逻辑性而且广泛使用的方式是贝叶斯定理。 它基于人获得的观察,作出的假设和已有的知识。

要注意的是,贝叶斯定理并不被之前讨论的几个学派所使用,因为他们眼中的概率是事物的固定属性,不该随人的观察,主观知识影响而改变。

这也不意味着其他学派就不会改变他们已经计算出的概率,只不过他们对概率的计算是直接基于分析和物理性质的研究的。比如当他们发现所研究的骰子其实有8个面时,则会说基于这个物理事实,每个面朝上的概率应该是 1/8 而不是 1/6.

逻辑概率

有的人大概觉得将概率定义为相信程度还是太随意宽泛了,多少得有点逻辑吧。因此,也有人提出了将概率定义为已有的逻辑支持程度。

逻辑概率的数值在0与1之间,0表示没有任何逻辑支持,所陈述的内容被认为是假的,而1则代表有充分的逻辑支持,所陈述的内容被认为是真的。

除此之外,概率这个数值还衡量了基于对于事物不确定性的程度,不确定性在概率为0.5时达到了最大。

与相信程度一样,逻辑概率也可以用贝叶斯定理来更新,因为贝叶斯定理,目前看来,是一种合理的逻辑。不同的是,逻辑概率通常对初始概率值的选择要求得更严苛一点。我们不应该一开始就说 “我的直觉告诉我它的概率是X,那我们先假定它是X,然后再收集信息来更新它。”

学派的现状

现在的统计概率学家仍持着不同的观点,支持不同的学派。但主要分为频率学派和贝叶斯学派。

前者强调概率是代表物体某个性质的恒定数值,与人相信与否无关,尽管真正获知这个数字可能很难,但我们可以尝试估计。

后者则觉得概率这不过是人的主观相信程度罢了,随着人对客观世界的认知而不断更新它就好。

总结

总结一下,写这篇文章的目讨论人类历史上对概率的主要思考 - “概率到底指什么”。

从最早的古典概型里的 “概率”,到随后理想化可重复事件里的频率,再回到现实中的“物理倾向性”。这些理论中的概率,都是严格而绝对基于客观事物的性质,与我们当下日常所说的概率有些不同。

随后的相信程度理论和逻辑支持程度理论,则更与当下人们直觉里的概率更接近。在这里,概率是主观的基于人类经验知识的数值,它也是可以随人对客观世界的观察发现而不断被更新的。

共同使用

与其说当下的理论就是最合理的,不如说这几种理论各有侧重点,互相弥补。

就比如说,当我们发现一件反复发生的事呈现出几种固定结果。

从频率学派角度,我们可以说,这个事物有产生A,B,C结果的物理倾向性,每个结果频率将越来越接近发生它的概率,用这个值来估计那个并不可知的概率是合理的。

而同时,我们也可以说,随着我们对此的观察,我们觉得结果A,B,C发生的概率分别是X,Y,Z。当我们有更多的发现时,我们将更新微调X,Y,Z。

当然啦,我们也可以忽略所有发生的事,像古典概型里那样做个逻辑分析,得出对每个结果的期望。

用哪种思维

我想,在讨论那些重复事件时,比如投掷骰子硬币,我们会发现把概率看作频率的分析方式很方便。

而当我们讨论不可重复的事时,通常得使用贝叶斯学派的方式来分析。

最后要强调的是,概率的不同学说都服从于 Kolmogorov 定义的3条公理

- 事件的发生概率大等于0

- 被定义的事件空间里,至少一个必须发生。

- 互斥事件同时发生的概率等于它们单独发生的概率之和。

基于公理的概率计算总是不会得到驳论,有据可循的。

更多

了解了概率学的历史之后,我们通常会重新思考曾学过的概率知识。

在下一篇文章里,我将更深入地介绍和讲解贝叶斯定理。

此外,还有一篇文章介绍了如何将现实数据代入贝叶斯公式来评估事件的概率。